چطور می توان جامعه و علم را از جعل عمیق نجات داد؟

به گزارش گروه هوش مصنوعی، فیلمها و تصاویر فریبنده بوجود آمده توسط هوش مصنوعی می تواند انتخابات را تحت تأثیر قرار دهد، سبب سقوط بازارهای سهام شود و شهرت افراد را نابود کند و محققان درحال توسعه روش هایی برای محدود کردن صدمه آن هستند.

به گزارش گروه هوش مصنوعی به نقل از ایسنا و به نقل از نیچر، ماه ژوئن سالجاری، در نبرد سیاسی منتهی به انتخابات مقدماتی ریاست جمهوری آمریکا در سال ۲۰۲۴، مجموعه ای از تصاویر منتشر گردید که نشان می داد دونالد ترامپ یکی از مشاوران پزشکی سابق خود، آنتونی فائوچی را در آغوش گرفته است. فائوچی، یک مقام بهداشتی بود که توسط برخی محافظه کاران آمریکایی به علت ترویج ماسک و واکسن در طول همه گیری کووید-۱۹ مورد انتقاد قرار گرفته بود.

هانی فرید(Hany Farid)، دانشمند کامپیوتر در دانشگاه کالیفرنیا، برکلی و یکی از خیلی از متخصصانی که تصاویر را بررسی کردند، می گوید: معلوم بود که آنها تقلبی بودند. با بررسی دقیق سه تا از عکس ها، موهای ترامپ به طرز عجیبی تار شده، متن در پس زمینه بی معناست، بازوها و دست ها به صورت غیرطبیعی قرار گرفته اند و جزئیات گوش قابل مشاهده ترامپ درست نیست. همه نشانه های بارز هوش مصنوعی مولد(AI) هستند که به آن هوش مصنوعی ساختگی هم گفته می شود.

چنین تصاویر و ویدئوهای جعل عمیقی که توسط تولیدکنندگان متن به تصویر با استفاده از هوش مصنوعی «آموزش عمیق» ساخته شده، هم اکنون بسیار زیاد است.

باآنکه کلاهبرداران مدت هاست که از فریب برای کسب سود، تغییر عقاید یا شروع جنگ استفاده می نمایند، سرعت و سهولتی که حالا میتوان حجم عظیمی از داده های جعلی کاملا متقاعد کننده ایجاد و منتشر نمود همراه با عدم آگاهی عمومی تبدیل به یک تهدید فزاینده شده است.

سینتیا رودین(Cynthia Rudin)، دانشمند کامپیوتر هوش مصنوعی در دانشگاه دوک در دورهام، کارولینای شمالی، می گوید: مردم به فناوری مولد عادت ندارند. این فناوری این گونه نیست که به تدریج تکامل یافته باشد. مثل بمب بود، ناگهان به وجود آمد. بنابراین، آن سطح از شک و تردید که لازم است، وجود ندارد.

ده ها سیستم هم اکنون برای کاربران ساده در دسترس هستند تا حدودا هر محتوایی را برای هر هدفی تولید کنند، خواه ایجاد ویدئوهای جعل عمیق از تام کروز در تیک تاک برای سرگرمی باشد خواه زنده کردن یک قربانی تیراندازی در مدرسه در یک فیلم با استفاده از هوش مصنوعی برای ایجاد یک ویدیوی حمایتی از تغییر مقررات اسلحه یا جعل کردن تماس یکی از دوستان و آشنایان برای درخواست کمک از جانب آنها و کلاهبرداری ده ها هزار دلار از افراد مختلف.

ویدئوهای جعل عمیق را میتوان در لحظه در یک تماس ویدیویی زنده تولید کرد. در اوایل سالجاری، جروم پاول(Jerome Powell)، رئیس بانک فدرال رزرو آمریکا، با فردی که فکر می کرد ولادیمیر زلنسکی(Volodymyr Zelenskyy)، رئیس جمهور اکراین است، گفتگوی ویدیویی داشت، اما اشتباه می کرد.

مقدار محتوای ساخته شده توسط هوش مصنوعی ناشناخته است، اما تصور می شود که این میزان درحال انفجار باشد. دانشگاهیان معمولاً تخمین می زنند که حدود ۹۰ درصد از کل محتوای اینترنت می تواند ظرف چند سال تبدیل به محتوای ساخته شده شود. رودین می گوید: این یافتن محتوای واقعی و مفید را دشوار می کند. او اضافه می کند که موتورهای جستجو و شبکه های اجتماعی تنها اطلاعات نادرست را تقویت می کنند.

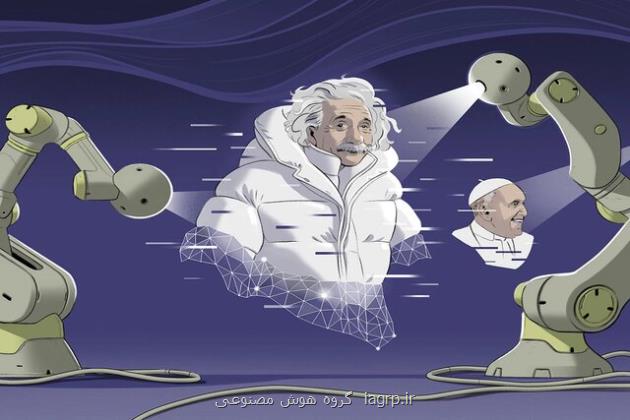

باآنکه خیلی از این محتواها برای سرگرمی ساخته شده اند، مانند تصویر پاپ فرانسیس که ژاکت پف دار پوشیده بود اما بعضی از آنها مخرب هستند. برای مثال یک فایل ساختگی می تواند موج ایجاد نماید. یک تصویر ساخته شده توسط هوش مصنوعی از انفجاری در پنتاگون ایالات متحده که در ماه مه در فضای مجازی انتشار یافت، سبب شد بازار سهام برای مدت کوتاهی افت کند. وجود محتوای ساختگی همینطور به بازیگران بد اجازه می دهد تا شواهد واقعی از رفتار نادرست شان را صرفاً با ادعای جعلی بودن آن رد کنند.

سوفی نایتینگل(Sophie Nightingale) روانشناس در دانشگاه لنکستر بریتانیا که اثرات هوش مصنوعی مولد را مطالعه می کند، می گوید توانایی مردم به جهت اینکه واقعا بدانند کجا باید اعتماد کنند درحال از بین رفتن است. و این یک مشکل واقعی برای دموکراسی است. ما باید در این مورد خیلی سریع عمل نماییم. این یک تهدید بزرگ است.

بعضی از کارشناسان می گویند جعل های ساخته شده توسط هوش مصنوعی هم می توانند تاثیرات زیادی بر علم داشته باشند. آنها نگرانند که توانایی های درحال توسعه سریع سیستم های هوش مصنوعی مولد بتواند انتشار داده ها و تصاویر جعلی را برای محققانی که به اصول اخلاقی پایبند نیستند، آسان تر کند.

هم اکنون، بعضی از محتوای ساختگی حاوی سرنخ هایی هستند مانند تصاویری که افراد را با شش انگشت در یک دست نشان می دهند. اما هوش مصنوعی مولد هر روز بهتر می شود. وائل عبدالمجید(Wael Abd-Almageed)، دانشمند اطلاعات و مهندس کامپیوتر در دانشگاه کالیفرنیای جنوبی در لس آنجلس می گوید: ما در مورد چند ماه صحبت می نماییم. زمانیکه مردم نمی توانند با چشم غیر مسلح تفاوت را تشخیص دهند.

پوشش چهره جعلی(سمت چپ) نظم بیشتری را نسبت به یک تصویر واقعی(سمت راست) نشان داده است

منبع: iagrp.ir

مطلب را می پسندید؟

(1)

(0)

تازه ترین مطالب مرتبط

نظرات بینندگان در مورد این مطلب